Pernah tak korang bayangkan dunia di mana korang pun tak tahu nak percaya seseorang pemimpin ni cakap betul atau tidak? Walaupun teknologi canggih zaman ni dah banyak tolong kita buat kerja, tapi teknologi jugalah yang boleh susahkan kita nanti. Setakat ni, kita dah boleh tengok sikit apa perkembangan salah satu teknologi yang amat berkuasa – teknologi deepfake.

Baru-baru ni pun, dah banyak wajah orang ternama yang jadi mangsa teknologi deep fake ni, antaranya Donald Trump, Scarlett Johanson dan Mark Zuckerberg.

Deep fake sebenarnya adalah gabungan istilah deep learning dan fake

Namanya mungkin pelik sikit, tapi ada alasan munasabah di sebalik tu. Deep fake ni sebenarnya adalah gabungan istilah deep learning dan fake. Sebagai pengguna media sosial, kita dah tau wujudnya risiko sesebuah fail imej, audio dan video yang tak sahih. Biasanya, fail-fail elektronik yang tak sahih ni dah kena ubah oleh orang yang tak bertanggungjawab.

Tapi apa tu deep learning? Korang bayangkan anatomi badan manusia yang banyak saluran darah tu. Ye, urat korang. Kemudian bayangkan lagi saluran-saluran kecil tu kat otak korang. Haa… hampir begitulah jaringan data yang terhubung dalam deep learning sebuah mesin pintar.

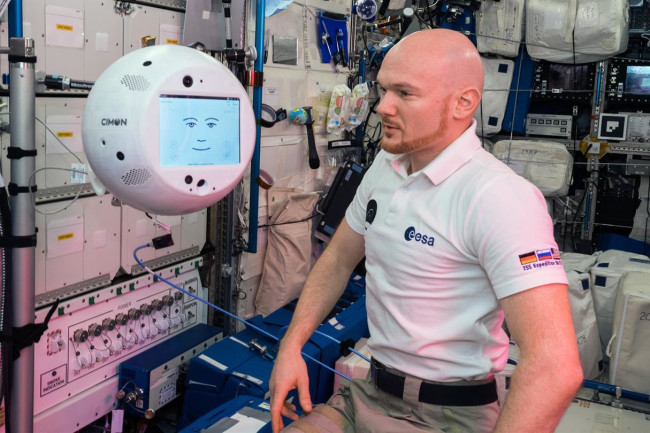

Dah faham sikit pasal deep learning, kini kami sentuh pula pasal deep fake. Deep fake ni biasanya guna klip video atau imej walaupun tak jelas sangat. Yang penting, sumber fail asalnya sudah cukup untuk kepintaran buatan manusia ni ‘faham’ perincian fail tu. Supasorn Suwajanakorn dalam ceramah pendek TED 2018 dah terangkan kenapa deep fake ni mudah dibuat daripada foto, audio dan klip video.

Macam mana nak guna teknologi deepfake?

Teknologi di sebalik deep fake ni sebenarnya datang dari Ian Goodfellow, seorang genius yang direbut Google dan Apple untuk bina teknologi kepintaran buatan. Teknologi tersebut dinamakan Generative Adversarial Networks (GANs). Beberapa keistimewaan GANs ni adalah ia boleh menjana imej sendiri dengan bantuan pelbagai jenis data imej yang lain.

GANs juga berupaya bantu kita untuk terjemah imej ke bentuk teks, ramal rupa kita dalam bentuk jantina yang berlainan (ye, macam filter Snapchat yang korang suka main tu) dan bayangkan objek dalam bentuk 3 dimensi. Kebanyakan keupayaan ni sudahpun kita pernah guna, sampai dah jadi bahan hiburan waktu lapang je.

Para pengkaji di University of Washington tunjukkan salah satu cara yang boleh digunakan untuk buat sebuah klip video ucapan yang pendek. Dengan model kepintaran buatan yang sesuai, prosesnya amat mudah manakala hasilnya cukup realistik.

Macam penerangan Supasorn Suwajanakorn dalam TED 2018 tadi, GANs boleh rangka dan ramal pergerakan mata, mulut dan otot wajah seseorang. Macam mana kalau takde orang boleh ajuk suara subjek sasaran korang?

“Kalau anda boleh menaip, anda sudah boleh cipta deepfake yang meyakinkan”- Kristin Houser

Kristin Houser pada 7 Jun lalu dah tulis pasal macam mana nak cipta suara yang sesuai untuk bagi sempurna lagi sesuatu bahan deep fake. Katanya, para pengkaji berjaya bina algoritma yang mampu belajar suara, intonasi dan gaya percakapan seseorang daripada klip suara je.

Salah satu cara lain adalah dengan guna deep video potraits, iaitu seorang pelakon yang boleh dijadikan rujukan oleh sesebuah mesin pintar untuk ditiru agar boleh terhasil sebuah klip video yang realistik. Korang bayangkan je lah kesan khas dalam filem sains fiksyen macam Avatar.

Bahaya deepfake, Ai akan makin bijak sebab mereka dah dibina untuk sentiasa belajar benda baharu

Macam mesej dan berita palsu yang lain, deep fake ni dah terang-terang bahaya. Lebih bahaya, benda ni tak semestinya dibuat oleh manusia. Macam yang dah kami sebut tadi, deep fake ni gunakan minda kepintaran buatan. Teknologi kepintaran buatan ni makin lama dah makin bijak sebab mereka dah dibina untuk sentiasa belajar benda baharu.

Kajian Bobby Chesney dan Danielle Citron (2018) cuba selami baik buruk deepfake. Dengan teknologi ni, kita boleh dengar kuliah dari Ibn Sina atau Albert Einstein, temu bual Tunku Abdul Rahman pasal kemerdekaan atau mungkin, berswafoto bersama Salvatore Dali. Selain tu, teknologi deepfake ni pun boleh hasilkan semula lukisan-lukisan terdahulu yang rosak sebagai cara pemuliharaan seni. Ataupun korang boleh tinggalkan avatar untuk temankan haiwan peliharaan korang kalau outstation.

Tapi kajian ni pun banyak tonjolkan buruk deepfake. Daripada nak kenakan kawan, ke bentuk fitnah atau skandal berunsur pornografi sampailah jadi bahan propaganda yang boleh jatuhkan sebuah kerajaan, deepfake bukan benda main-main. Paling jelas adalah ia boleh ganggu kestabilan politik sesebuah negara, serantau malah seluruh dunia.

Korang boleh cuba sendiri kemahiran korang untuk tengok mana satu wajah manusia sebenar dan mana satu wajah yang dijana oleh GANs di whichfaceisreal.com. Dengan guna FakeApp pula, korang boleh cuba sendiri sejauh mana berkuasanya GANs. Manakala ada sebuah laman web pula sediakan perkhidmatan untuk korang cuba sendiri buat video deepfake.

Lawan deepfake, soft biometric sebagai salah satu cara nak kesan wajah manusia sebenar

Teknologi deepfake semakin maju dan lebih menakutkan, teknologi ni ‘belajar sendiri’ dan ‘mencipta sendiri’ imej dan klip video yang boleh buat orang terpedaya. Kelebihan ‘belajar sendiri’ ni pun buatkan David Gunning, pengurus program Defense Advanced Research Projects Agency (DARPA) yang dibiayai kerajaan Amerika Syarikat tak rasa deepfake boleh dihentikan.

Namun ia tidak patahkan semangat Hany Farid, seorang profesor dan pakar forensik imej dari Dartmouth College untuk bina program yang boleh kesan deepfake. Anak didiknya, Shruti Agarwal tengah sibuk kembangkan kaedah soft biometric sebagai salah satu cara nak kesan wajah manusia sebenar dengan wajah yang dah dipalsukan.

Abdelgader Abdelwhab dan Serestina Viriri (2018) kata kelebihan soft biometric ni adalah ia boleh bezakan ciri-ciri unik antara manusia A dan manusia B. Ciri-ciri unik inilah yang GANs sukar untuk tiru dan akhirnya, deepfake boleh dikesan.

Cara lain nak kesan deepfake, ada beberapa kekurangan

Kami senaraikan kekurangan yang boleh korang aplikasikan untuk kesan deepfake setakat ni:

Deepfake adalah salah satu cabaran besar dalam zaman teknologi abad ke-21. Sebagai warganet yang bertanggungjawab, kita kena berhati-hati dan lebih teliti dalam menilai sesebuah klip video dan imej. Apatah lagi, platform media sosial dah mudahkan kita untuk kongsi maklumat kepada rakan hanya dalam beberapa saat ni menjadikan risiko teknologi GANs untuk disalahguna.